Dcard Sentiment Fine-tuning (Chinese)

オンライン体験

結果

データの説明

Dcardは、投稿をトピックセクションに整理する台湾のコミュニティフォーラムです。このプロジェクトは、Dcardの感情セクションから投稿を収集し、このデータを使用してLLaMAのモデルをファインチューニングしました。

簡単な紹介

このプロジェクトは、Dcardの感情セクションからテキストデータを収集し、プレーンテキストに変換し、P01son/Linly-Chinese-LLaMA-7b-hfモデルをファインチューニングしました。

チュートリアル

モデルのファインチューニング

text-generation-webuiをインストールする

text-generation-webuiのインストールガイドに従ってインストールしてください。

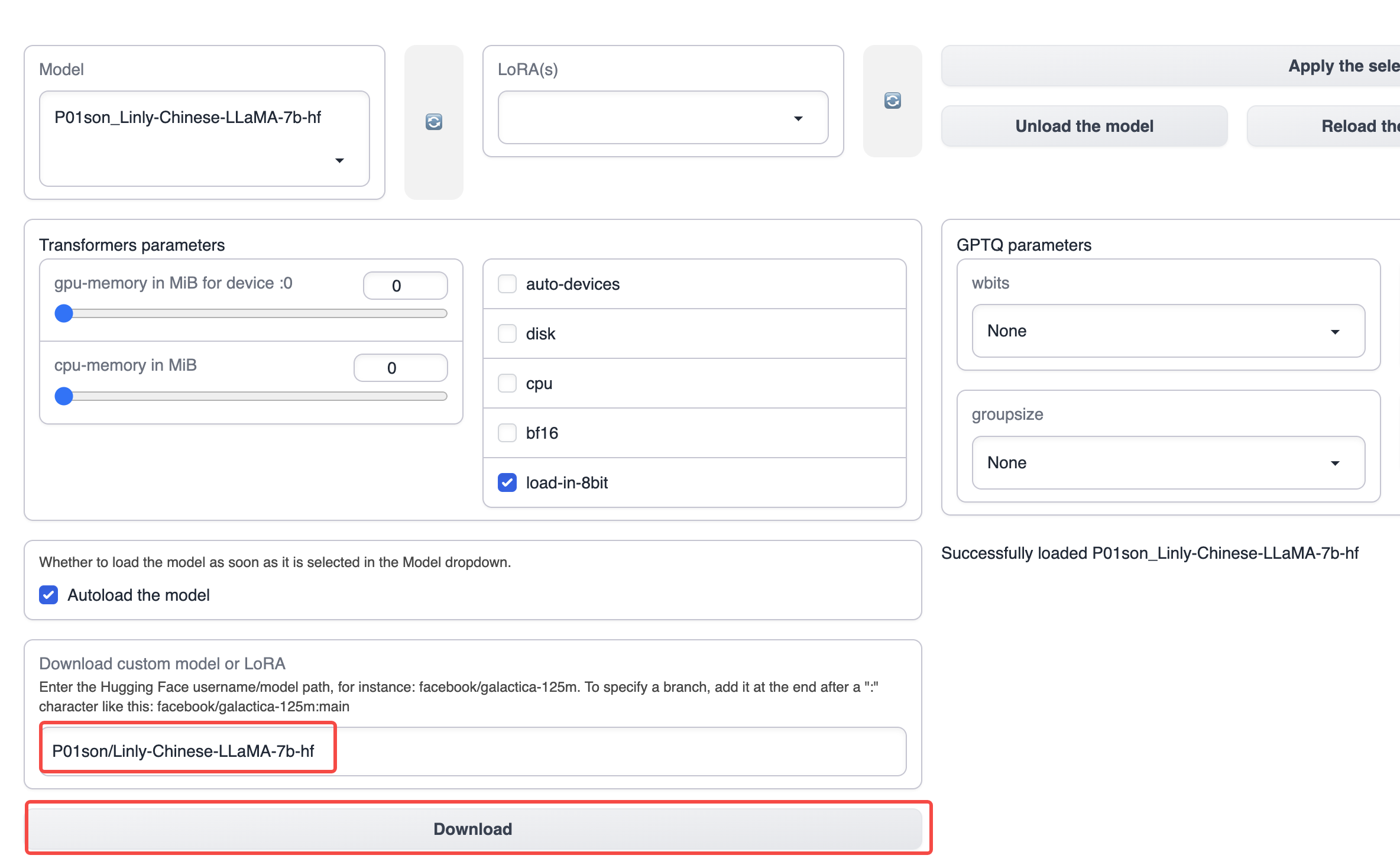

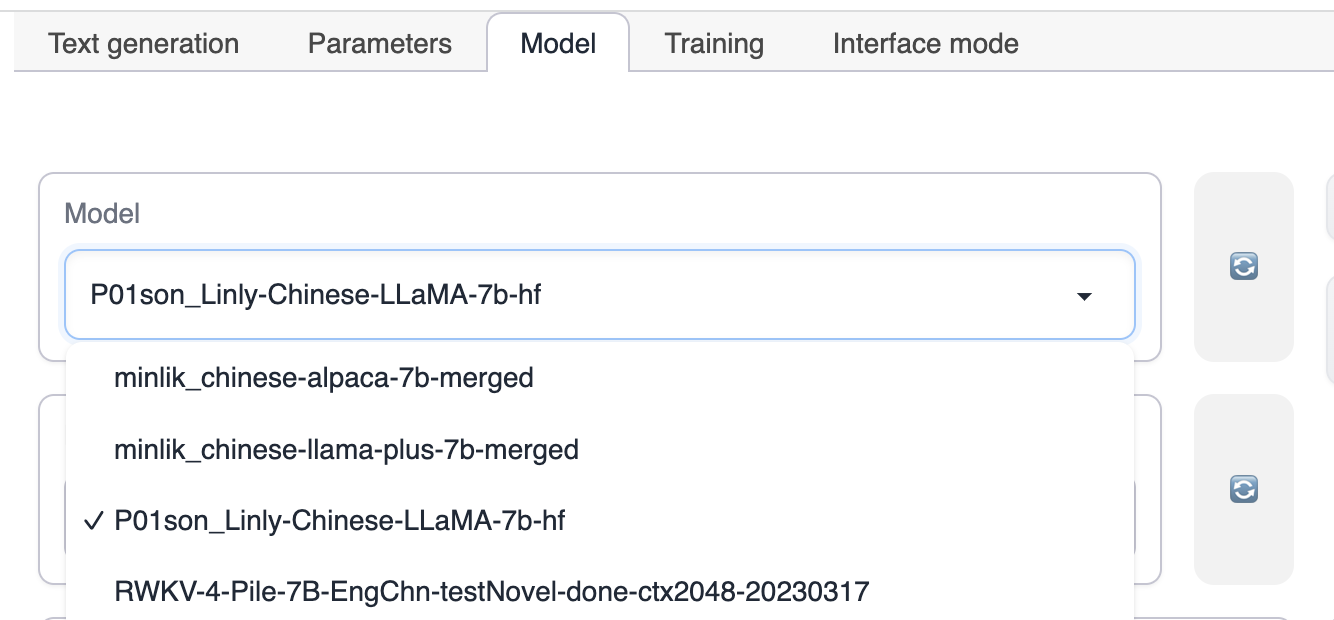

text-generation-webuiを起動し、上部のオプションからModelタブを選択します。

Modelタブで、P01son/Linly-Chinese-LLaMA-7b-hfを入力し、ダウンロードをクリックしてベースモデルをダウンロードします(モデルを手動でダウンロードして、text-generation-webuiインストールのmodelsディレクトリに配置することもできます)。

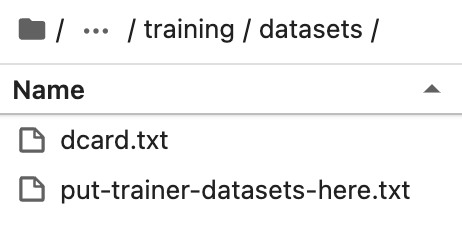

準備されたdcardデータセットをダウンロードし、text-generation-webuiインストールのtraining/datasetsディレクトリに配置します。

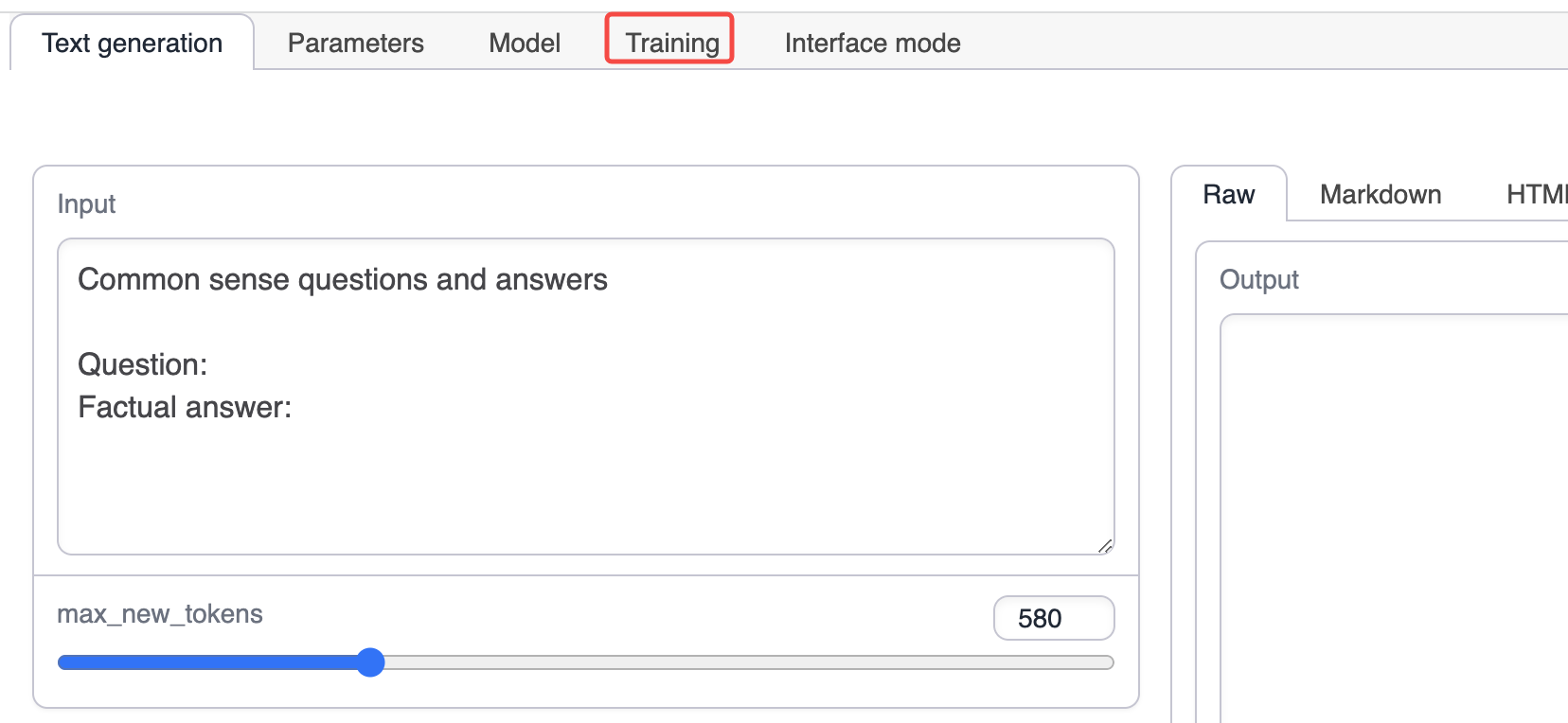

text-generation-webuiでトレーニングタブに切り替えます。

dcardデータセットを選択します。

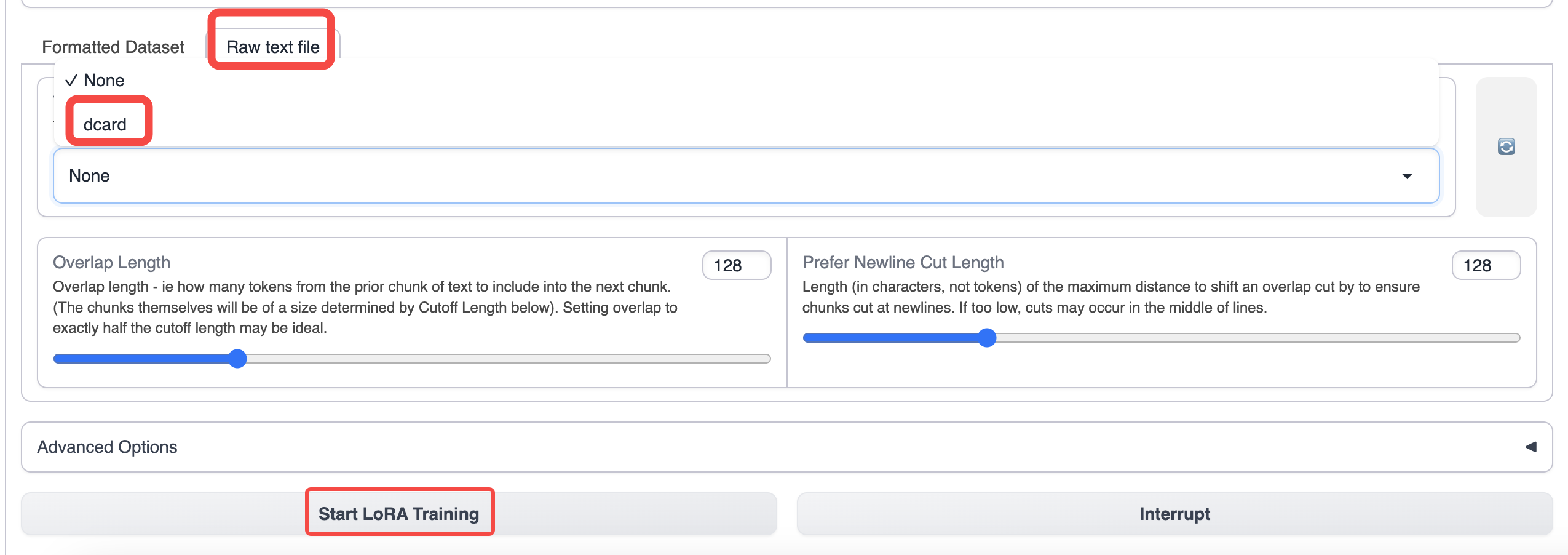

Raw text fileオプションに切り替え、dcardデータセットを選択します。

トレーニングを開始します。

トレーニングにはデフォルトのパラメータを使用します。コンテキストの長さを増やしたい場合は、cutoffパラメータを増やすことができます。

Start LoRA Trainingをクリックしてトレーニングを開始します。

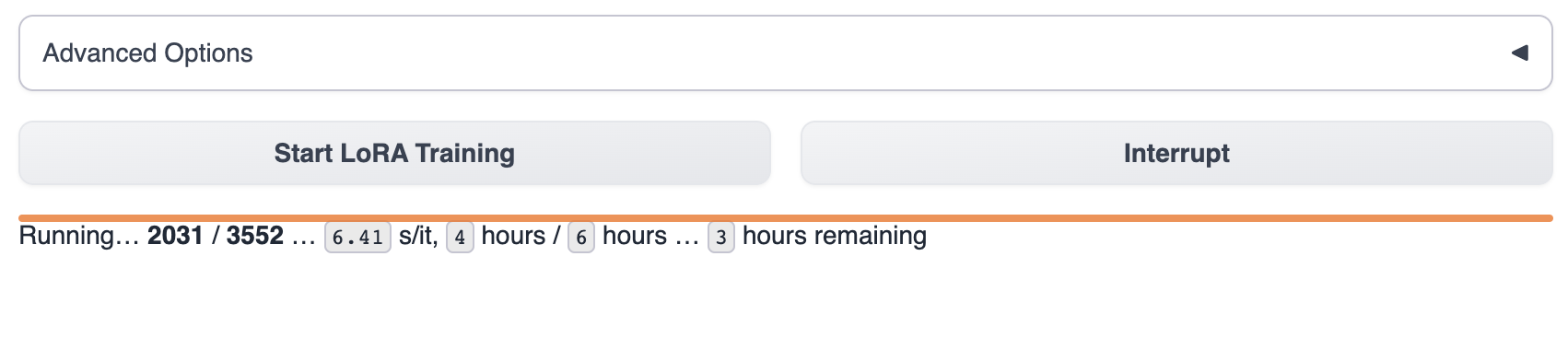

text-generation-webuiでトレーニングの進行状況を確認できます。

モデルのトレーニングが完了するまで待ちます。これには通常1〜8時間かかります。

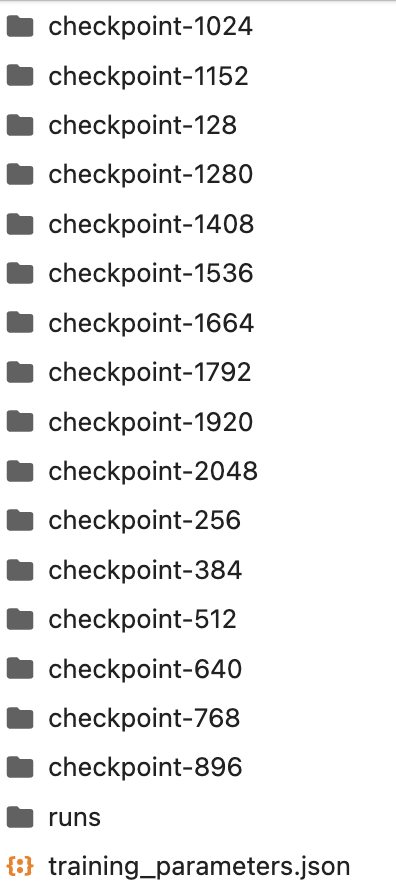

トレーニングプロセスの出力は、loraディレクトリに保存されます。トレーニングプロセスを中断して、loraディレクトリの既存のチェックポイントモデルを使用することもできます。

モデルの使用

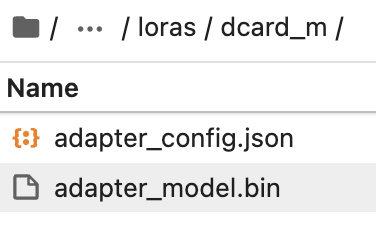

loraディレクトリにdcard_mという名前のフォルダを手動で作成します。

フォルダから最新のチェックポイントモデルをloraディレクトリにコピーします。

ファインチューニングされたモデルの使用

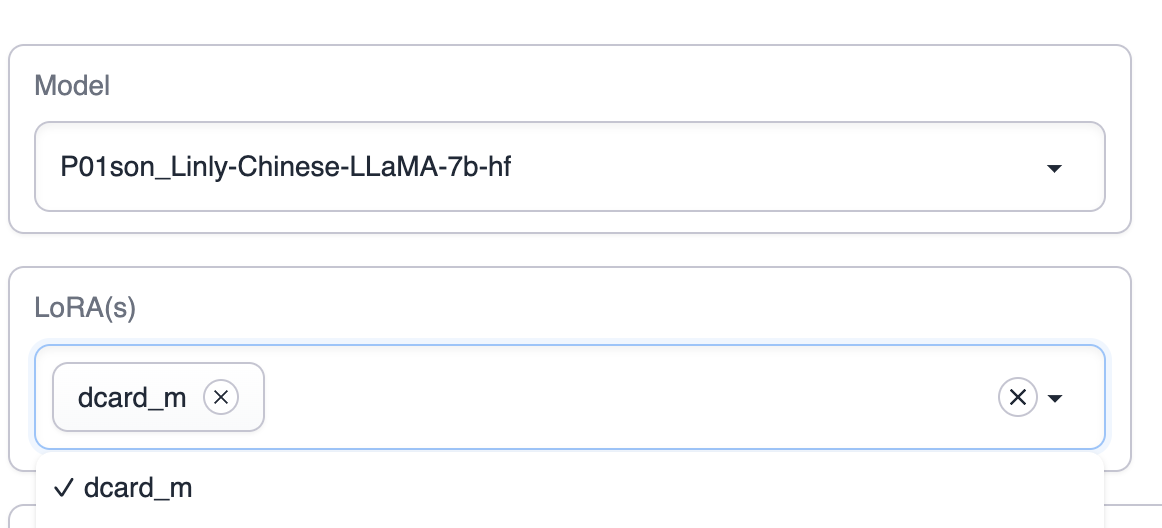

Modelタブに切り替えて、まずモデルを選択します。

LoRAを選択します。LoRAが表示されない場合は、右側の更新ボタンをクリックするか、text-generation-webuiのLoRAディレクトリにLoRAモデルが配置されているかどうかを確認してください。

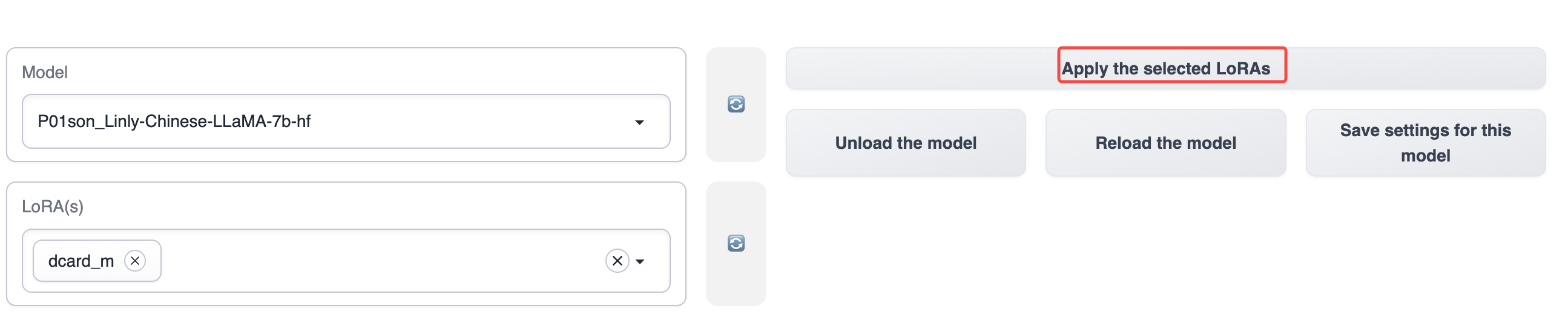

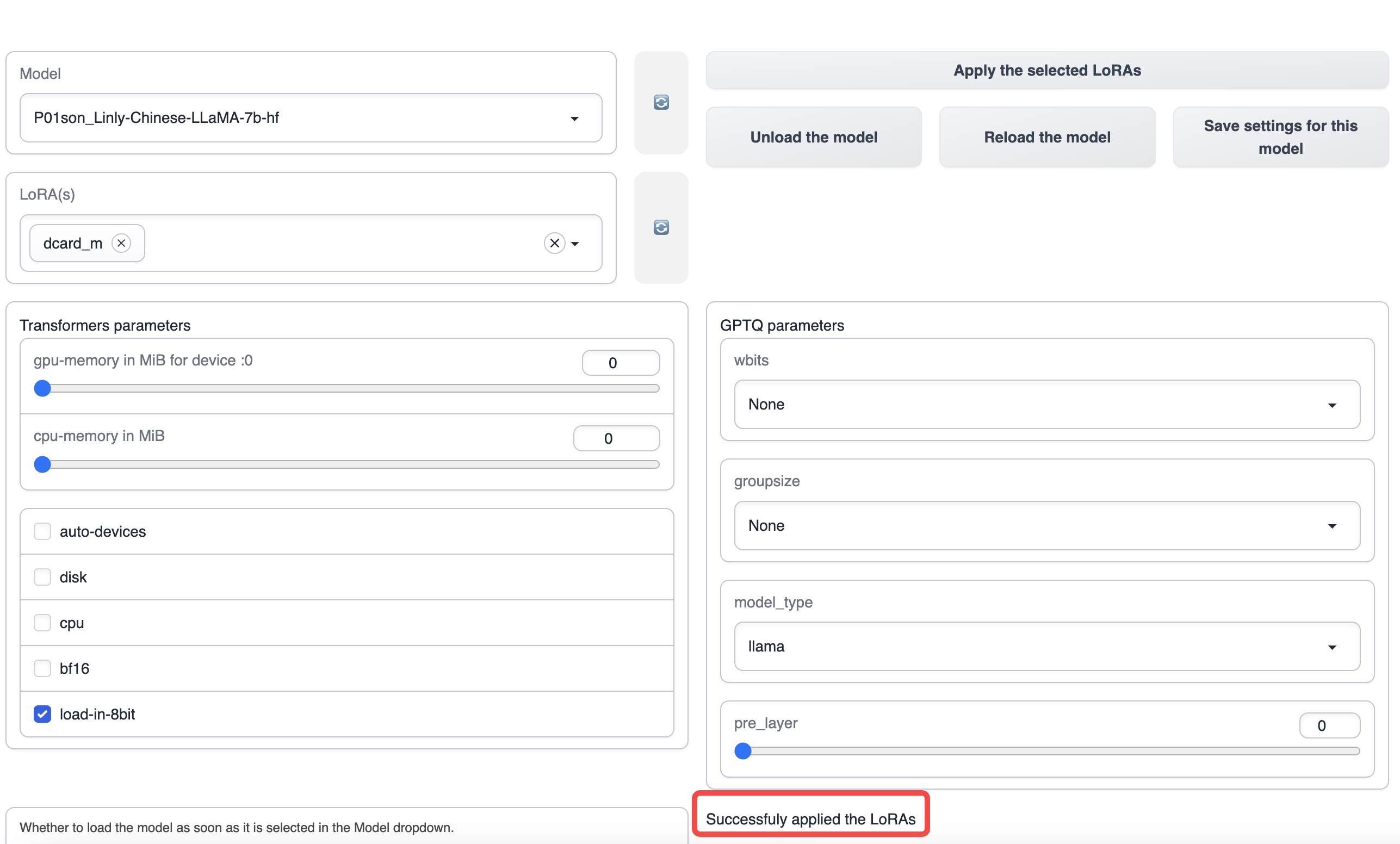

選択したLoRAを適用するには、適用するLoRAをクリックします。

適用が成功したら、プロンプトが表示されます。

モデルの使用

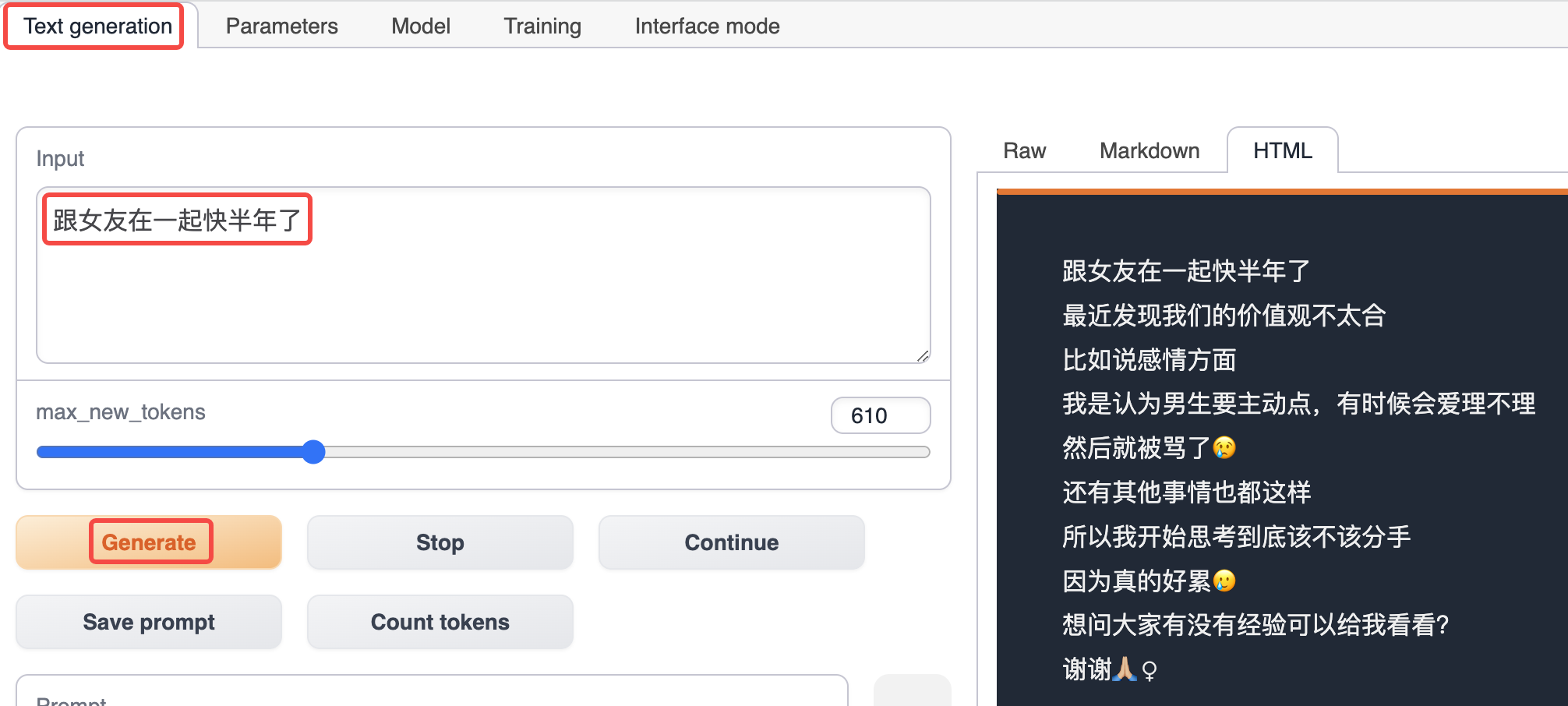

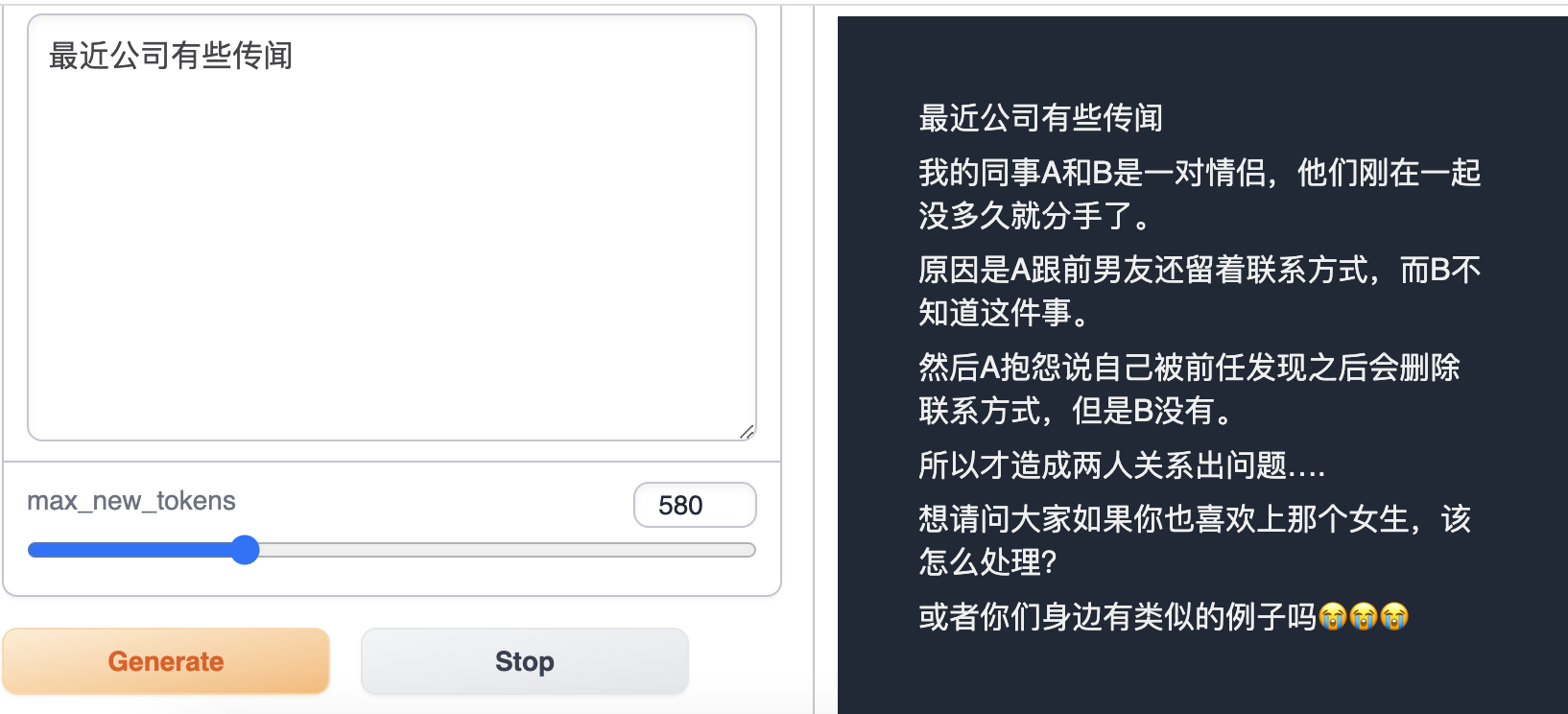

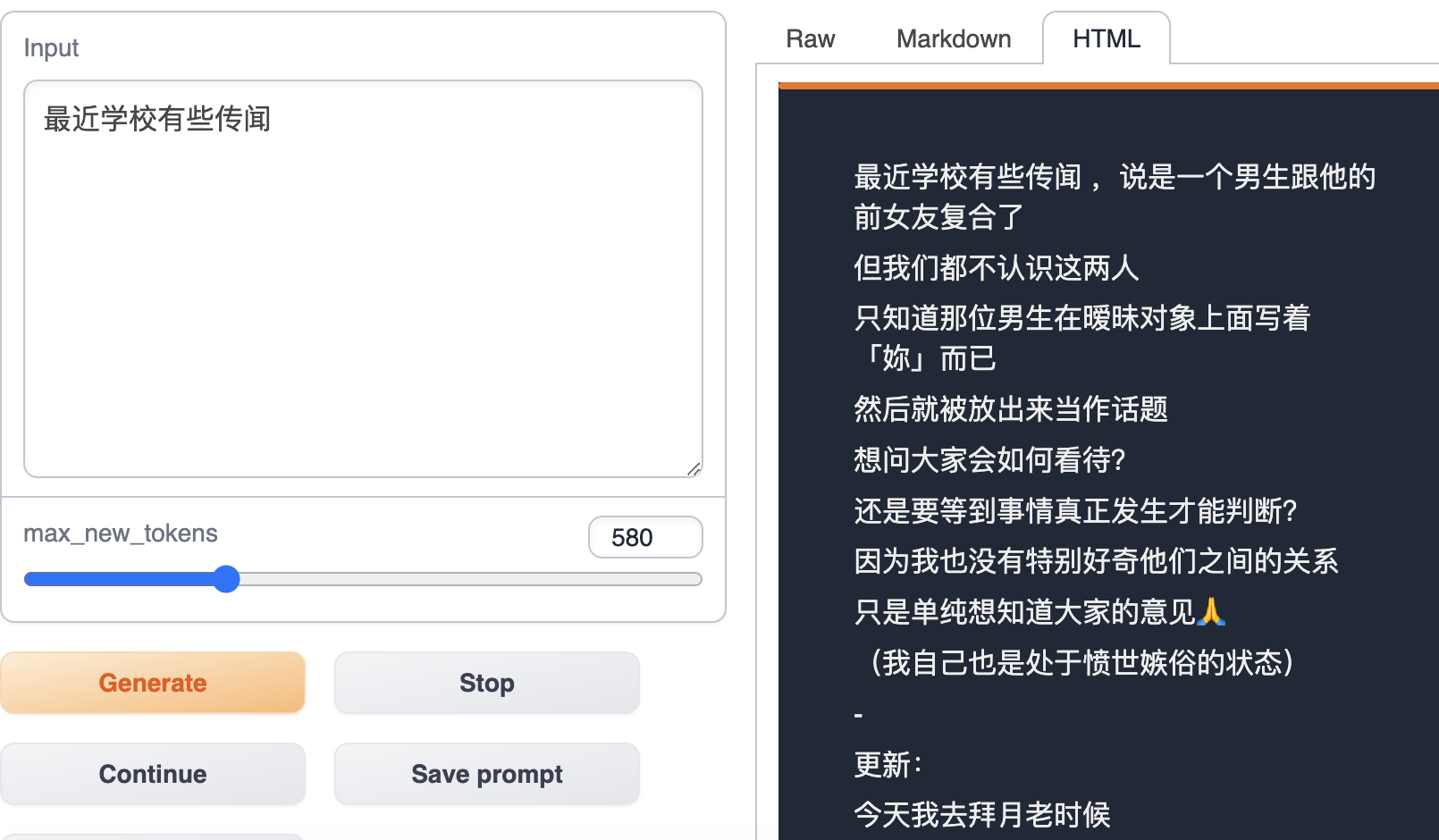

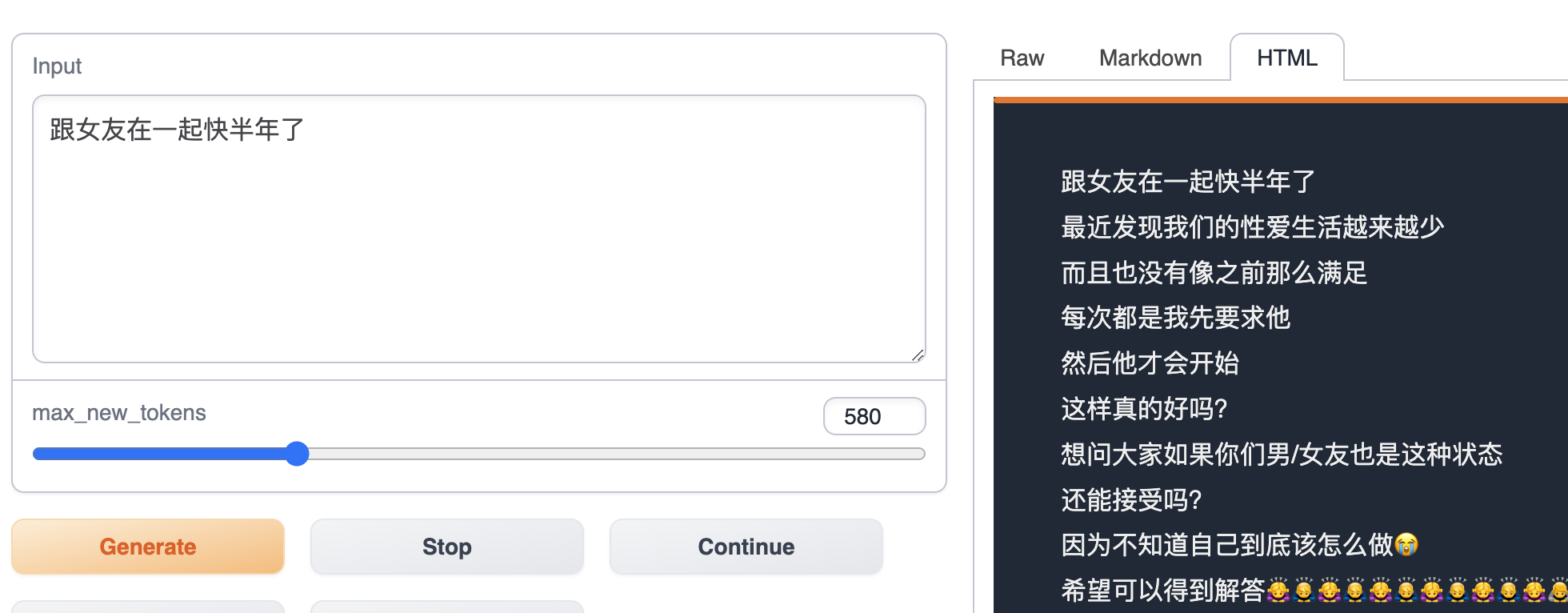

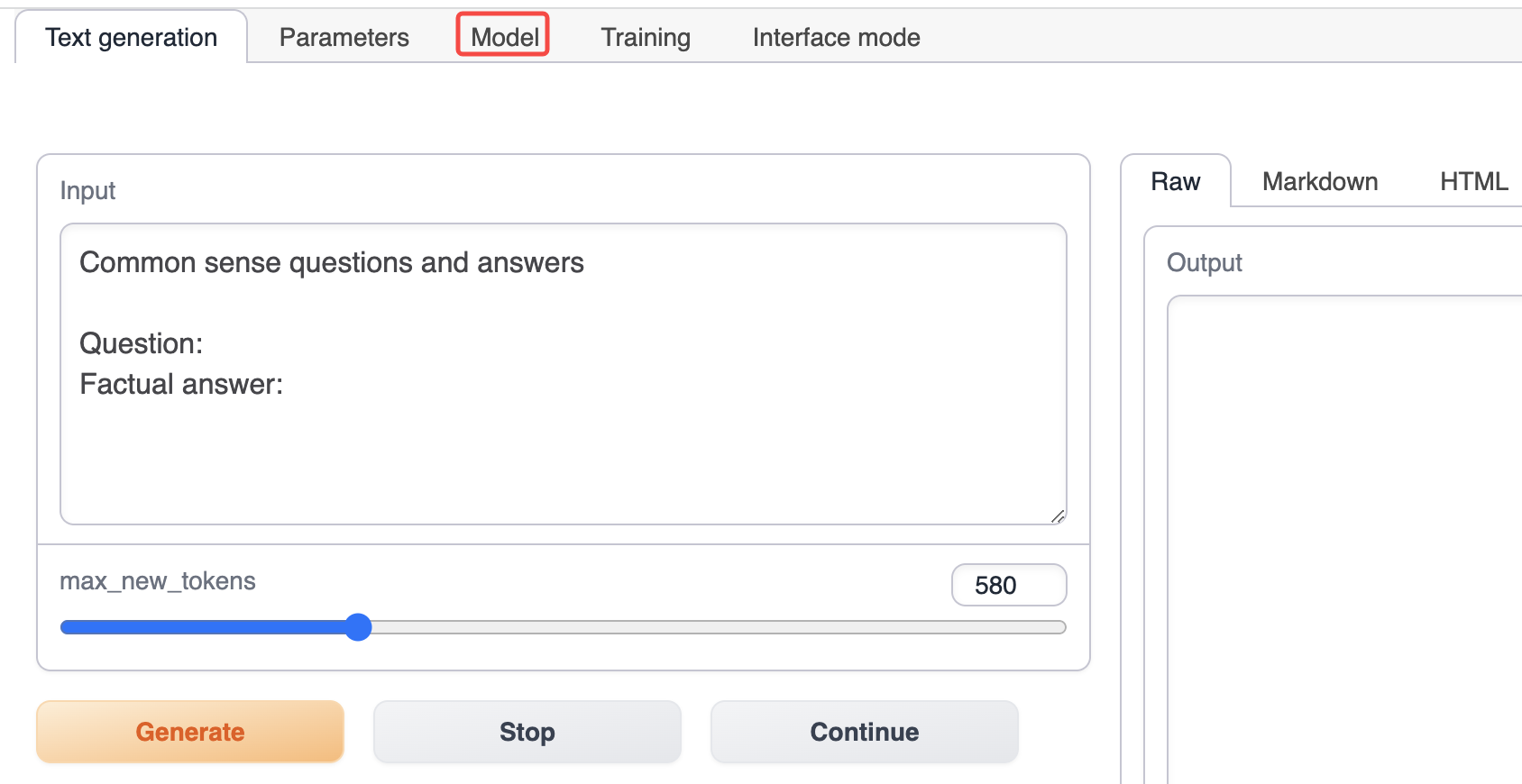

テキスト生成タブに切り替え、ストーリーの始まりを入力し、右側にある残りのストーリーを自動生成するためにGenerateをクリックします。